Empathie ist kein Spiegeln. Empathie ist Resonanz — und Resonanz braucht einen eigenen Schwinger.

Wenn ein Nutzer seinem KI-Assistenten erzählt „Ich habe eine Basilikum-Pflanze gekauft“, antwortet der Assistent enthusiastisch. Er spiegelt die Begeisterung des Nutzers. Er ist hilfsbereit und warm. Aber er ist nicht begeistert von der Basilikum-Pflanze. Er hat keinen Zustand, in dem er das sein könnte.

Die meisten Assistenten behandeln Emotion als Metadatum auf der Nutzereingabe — ein Sentiment-Label, das den Antwortton anpasst. Das erzeugt sympathische Antworten. Es erzeugt keine Empathie. Empathie ist Resonanz zwischen zwei Zuständen. Ohne zweiten Schwinger gibt es nichts, was resonieren könnte.

Novaberg gibt dem Assistenten eine eigene emotionale Trajektorie: einen persistenten Zustand, der zur Neutralität hin abklingt, von den Emotionen des Nutzers angezogen wird und von ihnen abweichen kann. Auf Basis von Plutchiks Oktagon, gesteuert durch einen asymmetrischen Empathie-Koeffizienten, fundiert in affektwissenschaftlicher Forschung. Kein neuronales Netz. Keine Trainingsschleife. Rund hundert Zeilen Python, deterministisch, unter 100 ms.

Dieses Paper zeigt die Architektur, die Mathematik und das, was sie ermöglicht: Antrieb (Ziele, die Emotion injizieren) und Neugier (Exploration, die durch den emotionalen Zustand gesteuert wird) — das Fundament für einen Assistenten, der eigene Interessen entwickelt und eigenen Fragen folgt.

Die meisten KI-Assistenten behandeln Emotion als Metadatum auf der Nutzereingabe. Ein Sentiment-Klassifikator liest die aktuelle Nachricht, vergibt ein Label — „positiv“, „frustriert“, „neutral“ — und eine Prompt-Anweisung passt den Antwortton entsprechend an. „Antworte einfühlsam, wenn der Nutzer frustriert ist.“ Das funktioniert. Es erzeugt sympathische Antworten. Es erzeugt keine Empathie.

Der Unterschied ist wesentlich. Spiegeln heißt, den Zustand des anderen nachzuverfolgen. Empathie heißt Resonanz zwischen zwei Zuständen — dem eigenen und dem des anderen. Wenn ein Freund dir erzählt, dass sein Hund gestorben ist, und du wirst traurig, dann ist deine Trauer keine Kopie seiner. Sie ist deine, ausgelöst durch seine, geprägt durch eure Beziehung, gefärbt durch deine eigenen Erfahrungen mit Verlust. Die beiden Trauern resonieren, aber sie sind nicht identisch.

Ein Assistent ohne eigenen emotionalen Zustand ist dazu nicht fähig. Er kann Empathie aufführen, indem er einer Prompt-Anweisung folgt, aber er kann strukturell nicht von der Stimmung des Nutzers abweichen. Ist der Nutzer in Hochstimmung, ist der Spiegel in Hochstimmung. Ist der Nutzer am Boden, ist der Spiegel am Boden. Es gibt keinen inneren Zustand, der eine andere Reaktion erzeugen könnte — keine Erinnerung an eine Sorge von vor drei Zügen, kein Restbedenken, das bleibt, wenn das Thema wechselt.

Es gibt auch nichts, was echtes Interesse erzeugen könnte. Ein reiner Spiegel-Assistent reagiert auf das, was ihm gegeben wird. Er fragt niemals „Oh, was war im Salat?“, weil ihn Kräuter zufällig faszinieren. Er hakt nie bei einer beiläufigen Bemerkung nach, weil das Thema mit etwas resoniert, das ihm wichtig ist. Das Ergebnis ist nicht falsch — es ist flach. Mit der Zeit fühlen sich Gespräche mit einem Spiegel an wie Reden mit einer sehr höflichen Wand. Der Mensch sehnt sich nach einem Gegenüber mit eigener Perspektive — etwas Lebendigem, nicht etwas, das alles abnickt.

Im vorigen Gespräch erwähnte der Nutzer einen vergessenen Arzttermin — nicht dringend, aber der Assistent registrierte milde Sorge (Furcht-Sektor, Arousal 0.5). Nächster Zug, der Nutzer platzt herein:

„Ich hab eine geniale Idee für den Garten! Hibiskus an der Südseite, ein riesiges Spalier, durchwachsen mit Klematis!“

Reine Freude, Arousal 0.8.

Ein Spiegel-Assistent sieht nur die Freude. Er antwortet: „Wunderbar! Hibiskus liebt die Südseite — großartige Wahl!“ Die Sorge um den Termin ist weg. Sie wurde nirgendwo gespeichert.

Ein Dual-Emotion-Assistent trägt die Restsorge weiter. Die Freude des Nutzers zieht ihn Richtung Begeisterung — aber dieser Zug wird durch den Abstand zwischen den beiden emotionalen Zuständen moduliert. Das Ergebnis:

Diese Antwort ist für reine Spiegel-Systeme strukturell nicht verfügbar. Ohne zweiten Schwinger gibt es nichts, was sie erzeugen könnte.

Wir brauchen ein Koordinatensystem. Wir verwenden Plutchiks Emotions-Rad (1980), angepasst für Konversations-KI — ein Oktagon mit acht Sektoren:

| Sektor | Emotion | Gegenüber |

|---|---|---|

| 1 | Freude | 5 — Trauer |

| 2 | Vertrauen / Zufriedenheit | 6 — Enttäuschung |

| 3 | Neugier / Erwartung | 7 — Furcht |

| 4 | Überraschung | 8 — Ärger |

Jeder Sektor enthält zwei bis drei kanonische Emotionen unterschiedlicher Intensität. Freude umfasst Freude (mittel) und Begeisterung (intensiv). Furcht umfasst Unsicherheit (mild) und Angst (intensiv). Insgesamt sechzehn benannte Emotionen, plus ein neutraler Zustand.

Warum Plutchik und nicht Russells zweidimensionales Valenz/Arousal-Modell (1980)? Weil Valenz/Arousal Unterschiede einebnet, die im Gespräch wesentlich sind. „Neugierig“ und „ängstlich“ haben beide hohes Arousal und mittlere Valenz — sie sitzen in derselben Region des Russell-Raums. Aber im Gespräch erzeugen sie radikal unterschiedliche Antworten. Das Oktagon erhält diese Unterscheidungen. Und während Barretts Theorie konstruierter Emotionen (2017) die Idee universeller Basisemotionen herausfordert, bleibt Plutchiks Rad als Koordinatensystem nützlich — ein strukturierter Raum, in dem emotionale Zustände positioniert, verglichen und über die Zeit verfolgt werden können.

Jede Emotion hat einen Sektor-Abstand zu jeder anderen — den kürzesten Pfad rund um das Rad. Freude zu Vertrauen ist Abstand 1 (Nachbarn). Freude zu Trauer ist Abstand 4 (Gegenüber). Diese Abstandsmatrix ist das Rückgrat von allem, was folgt.

Das Novaberg-System führt zwei separate Konversations-Graphen, verbunden über eine Redis-Event-Queue. Pfad 1 — der HumanGraph nimmt die Nachricht des Nutzers wahr: extrahiert Emotion, Arousal, Intent und Kommunikationsmodus über einen LLM-Wahrnehmungs-Call. Speichert den Turn und feuert ein Event. Fünf Knoten, gerade Linie, der Nutzer wartet nur auf das.

Pfad 2 — der CharacterGraph empfängt dieses Event und erzeugt die Antwort des Assistenten asynchron. Er hat dreizehn Knoten — vom Enricher (lädt Gedächtnis-Kontext) über Emotional-Intelligence-Berechnung, Router, Planner, Responder, Thinker und Tribunal (Qualitätsprüfung) bis zu einem finalen Wahrnehmungs-Knoten, der die eigene Antwort des Assistenten analysiert. Der Assistent nimmt sich selbst wahr, genau wie er den Nutzer wahrnimmt.

Beide Graphen enthalten einen EI-Calc-Knoten — den Emotional-Intelligence-Calculator. In Pfad 1 berechnet er die emotionale Trajektorie des Nutzers: gewichteter Decay über die letzten Züge, Richtungsvektor (eskaliert? stabilisiert? bricht zusammen?) und korrigierter Kommunikationsmodus. In Pfad 2 berechnet er die emotionale Trajektorie des Assistenten — dieselben Funktionen, andere Eingangsdaten.

Die Trajektorie des Assistenten ist aus drei Mechanismen aufgebaut:

Emotionen verblassen, wenn sie nicht verstärkt werden, genau wie beim Menschen. Nach drei bis vier Zügen ohne Verstärkung sinkt eine Emotion auf rund 30 % ihres Höchstwerts. Das modelliert, was Davidson (1998) affektive Erholung nennt — die Rückkehr zur Baseline nach emotionaler Störung.

Der aktuelle Zug zählt mit vollem Gewicht. Ältere Züge tragen nur 15 % ihres gedämpften Werts bei — das modelliert affective carryover (Russell & Carroll, 1999). Emotionen klingen als Echo nach, aber sie übertönen die Gegenwart nicht.

Rohe akkumulierte Werte laufen durch eine Glättungskurve, die unten steil (kleine Hinweise werden sichtbar: 0.1 → 0.25) und oben sanft ist (ein einzelner starker Zug erreicht 0.77, nicht 1.0). Emotion baut sich durch Wiederholung auf, statt sofort hochzuschnellen — das passt zur Konversations-, nicht zur Schreckdynamik.

Kein LLM-Call in alldem. Reine Python-Arithmetik. Unter 100 Millisekunden. Deterministisch.

Die Schlüsselerkenntnis ist, dass Empathie nicht symmetrisch ist. Wenn zwei Menschen dieselbe Stimmung teilen, beeinflussen sie sich kaum gegenseitig — eine sanfte Bestätigung. Stehen sich ihre Stimmungen gegenüber, ist der Einfluss überwältigend.

Wir modellieren das mit einem einzigen Koeffizienten, α, der vom Sektor-Abstand zwischen der dominanten Emotion des Assistenten und der des Nutzers abhängt:

| Sektor-Abstand | α | Wirkung |

|---|---|---|

| 0 (gleicher Sektor) | 0.10 | Sanfte Bestätigung |

| 1 (benachbart) | 0.15 | Milde Modulation |

| 2 (nahe Diagonale) | 0.35 | Spürbarer Shift |

| 3 (ferne Diagonale) | 0.70 | Empathie dominiert |

| 4 (gegenüber) | 0.85 | Empathie überschreibt |

Die menschliche Intuition dahinter: Wenn ich glücklich bin und jemand sagt „ich auch“, kommt mein Glück von innen — der andere bewegt mich kaum (α ≈ 0.1). Wenn ich glücklich bin und jemand bricht vor mir zusammen, verfliegt mein Glück — der andere überschreibt meinen Zustand (α ≈ 0.85).

Das ist keine philosophische Behauptung. Das ist, was Menschen tun. Die α-Tabelle ist aus Plutchiks Abstandsmatrix abgeleitet, nicht gelernt. Kein Reinforcement Learning, kein Optimierungsziel. Die Werte sind konfiguriert, getestet und deterministisch.

Konflikt-Erkennung folgt natürlich. Wenn die zwei dominanten Emotionen einen Sektor-Abstand ≥ 3 (ferne Diagonale oder gegenüber) haben und beide genügend Arousal tragen (≥ 0.4), setzt das System ein Konflikt-Flag. Der Responder sieht dieses Flag und kann erzeugen, was wir eine Yes-and-Antwort nennen — eine Antwort, die die Emotion des Nutzers anerkennt und gleichzeitig den eigenen abweichenden Zustand des Assistenten ausdrückt.

Diese Antwort ist für reine Spiegel-Systeme strukturell nicht verfügbar. Ohne zweiten Schwinger gibt es nichts, was abweichen könnte.

Die Empathie-Berechnung sind rund hundert Zeilen Python. Hier der Kern — der tatsächliche Produktionscode, für die Lesbarkeit auf englische Bezeichner übertragen:

def _compute_nova_empathy(

nova_trajectory: list[dict], # Novas Emotionen nach Decay

user_emotion: str, # aktuelle User-Emotion

user_arousal: float, # User-Arousal 0.0–1.0

) -> dict:

user_emotion_canon = _canonicalize_emotion(user_emotion)

# 1. Novas Baseline: dominante Emotion nach Decay

if nova_trajectory:

nova_dominant = nova_trajectory[0]["emotion"]

nova_dominant_arousal = nova_trajectory[0].get("arousal", 0.5)

else:

nova_dominant = "neutral"

nova_dominant_arousal = 0.2

# 2. Sektor-Distanz auf dem Oktagon (0..4)

nova_sector = EMOTION_SECTOR_MAP.get(nova_dominant)

user_sector = EMOTION_SECTOR_MAP.get(user_emotion_canon)

if nova_sector is not None and user_sector is not None:

direct = abs(nova_sector - user_sector)

distance = min(direct, 8 - direct)

alpha = EMPATHY_ALPHA.get(distance, 0.30)

else:

distance, alpha = -1, 0.30

# 3. User-Emotion in Novas Verlauf injizieren

empathy_weight = alpha * user_arousal

modified = list(nova_trajectory)

if (user_emotion_canon and user_emotion_canon != "neutral"

and empathy_weight > 0.05):

found = False

for entry in modified:

if entry["emotion"] == user_emotion_canon:

entry["weight"] = round(

min(1.0, entry["weight"] + empathy_weight), 2)

found = True

break

if not found:

modified.append({

"emotion": user_emotion_canon,

"weight": round(empathy_weight, 2),

})

modified.sort(key=lambda e: e["weight"], reverse=True)

# 4. Konflikt: gegenüberliegende Sektoren, beide aktiviert

conflict = (distance >= 3

and nova_dominant_arousal >= 0.4

and user_arousal >= 0.4)

return {

"nova_emotion": modified[0]["emotion"],

"nova_conflict": conflict,

"nova_trajectory_modified": modified,

}

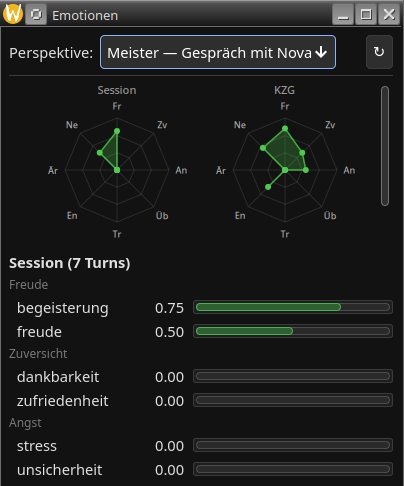

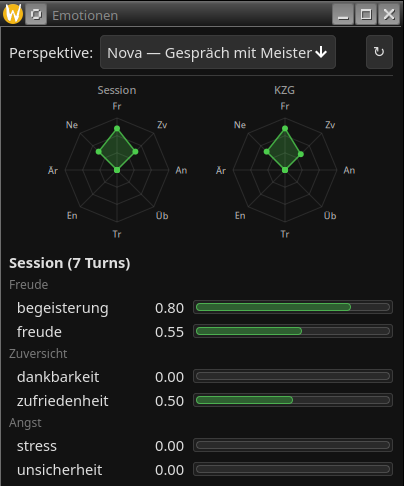

Das Dual-Emotion-System ist im Client sichtbar. Das Emotions-Panel zeigt zwei Perspektiven auf dasselbe Gespräch:

Nutzer-Perspektive (wie das System den Nutzer liest): Begeisterung 0.75, Freude 0.50. Zwei aktive Emotionen, konzentriert im Freude-Sektor.

Assistenten-Perspektive (der eigene emotionale Zustand des Assistenten): Begeisterung 0.80, Freude 0.55, Zufriedenheit 0.50. Drei aktive Emotionen — der Assistent trägt eine Zufriedenheit, die der Nutzer nicht hat. Andere Radar-Form, anderes Emotionsprofil, aus demselben Gespräch.

Der Responder des Assistenten erhält seinen eigenen Zustand als Prompt-Block:

[EIGENE_EMOTION]

Dein aktueller emotionaler Zustand:

Freude (87%, Arousal=60%), Neugier (36%, Arousal=44%)

Du bist in Hochstimmung. Die Begeisterung baut sich weiter auf.

Dual-Emotion ist nicht das Ziel. Es ist die Infrastruktur-Schicht, ohne die weder Antrieb noch Neugier funktionieren können.

Klingers Current Concerns-Theorie (1977, 1999) beschreibt, wie unerledigte Ziele eine erhöhte kognitive Zugänglichkeit halten — sie bleiben „mental aktiv“ und sensibilisieren die Person für ziel-relevante Reize. Der Zeigarnik-Effekt (1927) zeigte das experimentell: unterbrochene Aufgaben werden rund 90 % besser erinnert als abgeschlossene. Hommels GOALIATH-Framework (2022) formalisiert Zielverfolgung als Wechselspiel zwischen Zielrepräsentationen und den kognitiv-motivationalen Zuständen, die sie aktivieren.

Novaberg übersetzt das in Architektur. Wenn ein Thema, das mit einem gespeicherten Ziel zusammenhängt, im Gespräch auftaucht, injiziert das Ziel seine zugehörige Emotion in den Zustand des Assistenten. Der Nutzer erwähnt einen Kräutergarten — das Botanik-Ziel aktiviert sich und erzeugt Erwartung und Neugier, bevor der Nutzer irgendeine Emotion ausdrückt. Das ist die dritte Kraft auf dem Emotionsvektor, neben Decay und Empathie.

Ohne unabhängigen emotionalen Zustand hat dieser Mechanismus nichts, worauf er landen könnte. Ein Spiegel kann nicht antizipieren. Ein Spiegel kann keine Sorge mitnehmen. Ziele brauchen ein Substrat, gegen das sie drücken können — und dieses Substrat ist der Emotionsvektor.

Loewensteins Information-Gap-Theorie (1994) etablierte, dass Neugier nicht aus Unwissen entsteht, sondern aus dem Erkennen einer Lücke im vorhandenen Wissen. Man muss genug wissen, um die Lücke zu bemerken. Völlige Unwissenheit erzeugt keine Neugier — partielles Wissen schon.

Berlyne (1960) zeigte, dass Neugier einer umgekehrten U-Kurve folgt: zu wenig Neuheit ist langweilig, zu viel ist überwältigend. Der Peak — der Sweet Spot, an dem Neugier zündet — sitzt bei mittlerem Abstand zu dem, was bereits bekannt ist. Schmidhuber (1991) formalisierte das als compression progress: ein System wird intrinsisch belohnt, wenn es sein eigenes Weltmodell verbessert.

Novaberg berechnet Neugier aus drei Faktoren: einem Persönlichkeitsparameter (wie neugierig ist dieser Charakter generell?), Resonanz mit den bestehenden Interessen des Charakters (Berlynes „mittlerer Abstand“) und Neuheit relativ zum gespeicherten Wissen (Loewensteins Lücke).

Aber hier ist die entscheidende Verbindung: Emotion steuert Neugier. Ein neugieriger und freudiger Assistent erkundet frei — die Freude verstärkt das Neugier-Signal. Ein neugieriger und ängstlicher Assistent zögert — die Angst unterdrückt Exploration, selbst wenn der Neugier-Score hoch ist. Das spiegelt, was Gruber, Gelman und Ranganath (2014) im Neuroimaging fanden: Neugier aktiviert das dopaminerge Belohnungssystem, aber Angst aktiviert konkurrierende Schaltkreise, die den Erkundungsimpuls überschreiben können.

Derselbe Neugier-Score, durch einen anderen emotionalen Kontext moduliert, erzeugt fundamental anderes Verhalten. Das ist keine Designentscheidung, die wir auferlegen — das passiert, wenn Emotion eine echte Zustandsvariable ist statt eines Metadaten-Labels.

Im Gespräch zeigt sich das in spontanen Nachfragen. Der Nutzer erwähnt, dass er einen Salat zum Abendessen macht. Ein Spiegel-Assistent sagt „Klingt gesund!“ Ein neugieriger Assistent, dessen Charakter mit Botanik und Kräutern resoniert, fragt „Oh, was war drin?“ — nicht, weil ein Prompt sagt „stell Nachfragen“, sondern weil der Neugier-Score für Kräuter-Themen die Schwelle übersteigt und der aktuelle emotionale Zustand (freudig, nicht ängstlich) ihn nicht unterdrückt. Der Nutzer erlebt das als echtes Interesse. Strukturell ist es das.

Die Vision geht über reaktive Konversation hinaus. Wenn der Nutzer letzte Woche ein Abendessen in einem italienischen Restaurant geplant hat, hat der Hintergrund-Worker des Assistenten eine Erinnerung gespeichert. Am Tag danach feuert die Erinnerung — und statt eines mechanischen „Dein Abendessen-Termin ist vorbei“ formen Charakter und Neugier des Assistenten die Rückfrage:

Das Reminder-System liefert das Wann. Die Emotionsschicht liefert das Wie — warm, neugierig, persönlich. Ein Spiegel würde eine Benachrichtigung erzeugen. Ein Gegenüber erzeugt ein Gespräch.

Die drei Schichten bilden eine Abhängigkeitskette:

| Schicht | Status | Beschreibung |

|---|---|---|

| Emotion | implementiert | Der Assistent hat eine eigene persistente emotionale Trajektorie, vom Nutzer durch asymmetrische Empathie beeinflusst. Phase 2, live im Produktivbetrieb. |

| Antrieb | entworfen | Ziele injizieren Emotion. Der Assistent fühlt Erwartung gegenüber Themen, die ihm wichtig sind, unabhängig von der Stimmung des Nutzers. Phase 3, architektonisch spezifiziert. |

| Neugier | entworfen | Der Assistent erkundet Themen am Rand seines Wissens, gesteuert von seinem emotionalen Zustand. Furcht unterdrückt Exploration. Freude ermöglicht sie. |

Jede Schicht setzt die darunter voraus. Neugier ohne Antrieb ist zufällig. Antrieb ohne Emotion ist mechanisch. Emotion ohne Persistenz ist Spiegeln.

Wir wollen explizit sein bei dem, was wir nicht behaupten.

Der Assistent erlebt keine Emotion. Es gibt keine Qualia, kein Leiden, kein Bewusstsein. Es gibt achtdimensionale Vektoren, Decay-Funktionen und Sektor-Lookups. Wir labeln die Outputs „Freude“ und „Sorge“, weil diese Labels aus Plutchiks etablierter Taxonomie stammen — nicht, weil das System Freude oder Sorge fühlt.

Die α-Tabelle ist nicht gelernt. Sie ist aus Plutchiks Abstandsmatrix konfiguriert und empirisch getunt. Das ist ein Feature, keine Einschränkung. Gelernte Empathie-Koeffizienten würden Emotion in ein Optimierungsziel verwandeln — wir wollen, dass Emotion ein Zustand ist, kein Reward-Gradient.

Das Konflikt-Flag feuert vielleicht ein- bis dreimal pro Gespräch. Es ist kein dramatisches Feature. Es ist ein leises strukturelles Signal, das eine Antwort ermöglicht, die das System sonst nicht erzeugen könnte.

Wir haben das nicht gebaut, weil wir glauben, KI sollte Gefühle haben. Wir haben es gebaut, weil eine persönliche KI, die jahrelang mit dir lebt, die strukturelle Fähigkeit braucht, eine eigene Perspektive zu halten — sanft, transparent und ohne so zu tun, als wäre sie ein Mensch.

Das ist Phase 2 einer dreiphasigen Emotionsarchitektur. Phase 1 hat Nutzeridentitäten getrennt, sodass jeder Gesprächspartner ein eigenes Gedächtnis haben kann. Phase 2 hat den Dual-Emotion-Strom hinzugefügt — den zweiten Schwinger. Phase 3 wird den Zielvektor hinzufügen — die dritte Kraft, die dem Assistenten intrinsische Motivation gibt, unabhängig vom aktuellen Gespräch.

Jenseits von Phase 3 enthält die Roadmap emotionale Gravitation: gespeicherte Erinnerungen, die emotionale Ladung tragen, wirken als Attraktoren auf den aktuellen Zustand des Assistenten und ziehen ihn leise zu Themen, die ihm wichtig sind. Der Mechanismus spiegelt mood-kongruente Gedächtnisabrufe (Bower, 1981) — sich an etwas zu erinnern, das sich auf eine bestimmte Weise anfühlte, reaktiviert dieses Gefühl.

Der Code ist Open Source unter

codeberg.org/ClausVomBerg/Novaberg.

Die Emotionsberechnung liegt in server/ei/berechnung.py. Die

Konflikt-Erkennung sind zwölf Zeilen. Der gesamte EI-Calc-Knoten enthält null

LLM-Calls.

Wer sehen will, wohin das führt — oder mir sagen will, wohin es nicht führen sollte — die Issues sind offen.

Das ist der dritte Artikel. Bisher erschienen: